Chat GPT两大底层能力解析

之前也写过一篇关于GPT的文章,那时聊得其实都挺浅显的,感兴趣的小伙可以回看一波《怎么让人工智能为我们服务》,这次再写GPT的文章,其实更多是带着学习研究和深入利用的目的,如果有任何聊得不太清楚或不太懂的地方,都可私信研讨。

一、甚么是CHAT GPT

虽已经是陈词滥调了,但或者想解释一下。智如其名,GPT是一个训练有素的对话式文本生成Ai;包括输入端人类发出的有效发问 ( Prompt )和输出真个智能参考答案。

GPT的运行方式,其实挺像一个共享的超级大脑: 我们提交问题,云真个GPT大脑会基于预训练好的能力"计算"出结果。

它是一种逻辑语言推理大模型,本质上这个模型是一种神经网络,能够读取并理解大量的自然语言文本,像人类一样"驾驭"语言,可以这么理解: 只要你会“说话”,就可以通过GPT来解决问题。

二、CHAT GPT的底层能力

GPT除背后强大的“计算”能力外,能够让它有效的称之为人工智能( 而不是过去傻瓜式的模型 ),其实离不开它两大的底层能力。

1. 出现 ( Emergence ): 会表达

随着GPT模型迭代的参数量变,ChatGPT对世界的认知产生了质变。它不再是单纯记住预训练的信息。现在的信息会通过理解,再被提炼为知识,然后这些知识由GPT为你表达。

而到了GPT⑷,可以说它已具有了超出认知的创造力了。

这个进程跟我们人脑的进化,挺类似的,神经元发展到一定数量后,某些人就具有了超出常人的能力。

出现能力,可以简单理解为“GPT能够表达”这件事情。

2. 思惟链(CoT): 能推理

GPT3 以后的模型泛化出了思惟链( Chain-of-Thought ) 的能力,这个能力是模型出现新能力的关键机制,你可以把它理解为GPT的推理能力 ( Resoning )。

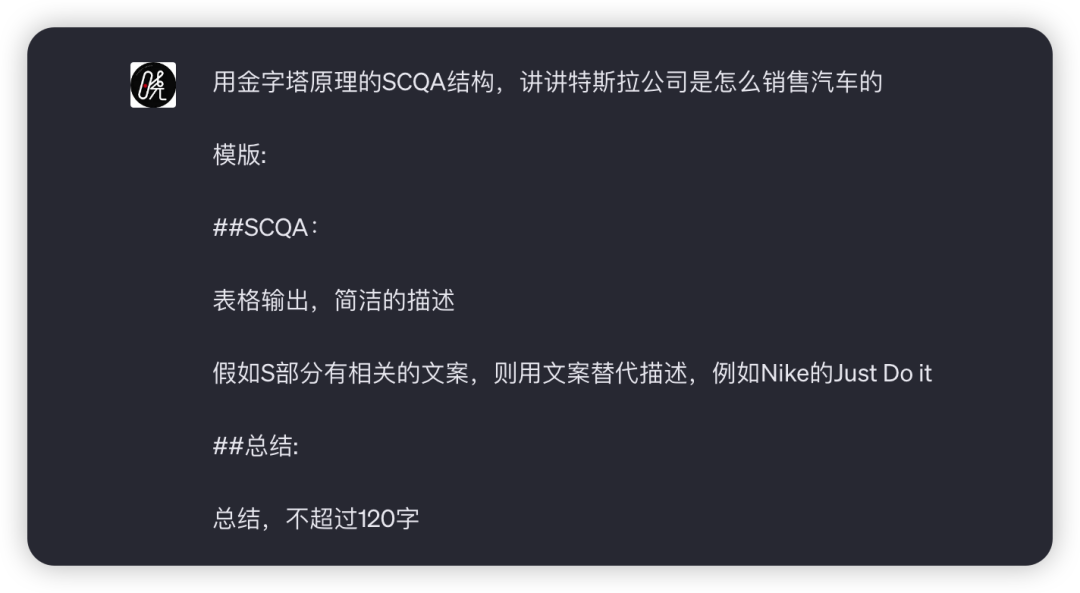

比如我希望GPT结合金字塔原理的SCQA ( 一种思惟模式 ),说一说特斯拉公司是怎样销售汽车的。

这就没法通过搜索来拼凑答案,但是GPT就可以给你说出来。

那利用这个机制,使用各种思惟链的提示方法,是可让GPT变得更聪明、更有效的。

当深入了解GPT的能力后,你会发现在解决问题的层面上,真正起作用的是GPT的推理能力,就是有效的输入和GPT的推理,决定了终究的输出。

当了解GPT具有了这两大底层能力后,会发现它不只是一个简单解惑的语言模型,通过Prompt的设计和微调,是可以实现解决各种需求问题的。

我也在渐渐地学习和研究GPT如何更好地协助我们去解决需求问题,除解惑以外,做更多真正解决问题的事情。

让GPT成为一个超级智能助手,应当也不是不可能 ( 由于GPT⑷已在干着这样的活了 )。

三、警惕Ai幻觉

Ai幻觉,是指人工智能模型的自我欺骗现象;通常被定义为“生成的内容与提供的源内容无意义或不可信”。简单理解,就是一本正经地胡说八道。

虽然GPT很强大,但也有buff,Chat GPT的知识库目前是截止到2021年的,而且它当前是不能联网的。2022年后出现的新概念,它是不知道的,所以当问它有关比较前沿的专业性知识时,需要考究数据的来源和出处。

更重要的是,要结合本身专业领域的知识去判断它给出的回答的准确性和可靠性,而不是盲目地去相信。

四、人工智能时期已来

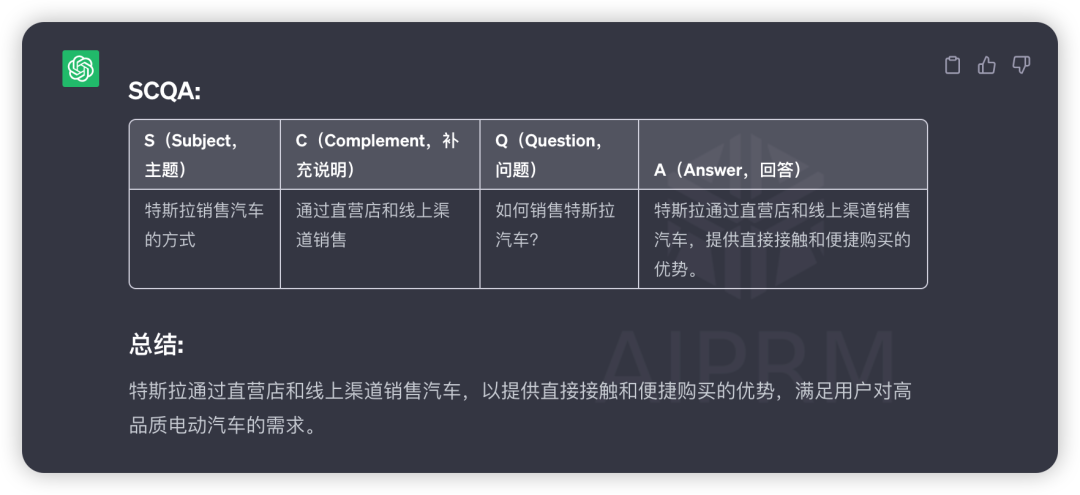

Chat GPT的发布,正式宣布了人工智能时期已到来了。分享一下Salesforce履行总监对人工智能的一个观点 —— 你能看见它,你就可以实现它。

很多时候过去我们所不能实现的事情,现在通过人工智能已变得能实现了:一句话就可以把事情办完。

机器已能愈来愈理解人想表达的意图,能理解人要做的事情。工业革命解决了“重复体力劳动“的事情,人工智能未来将解决“重复脑力劳动”的事情。

在过去的几百年里,每次革命都在摧毁一些职业的同时也在创造一些新的工作岗位。人工智能时期也一样,张小龙曾说过:希望我们的产品能成为用户的朋友,而不单单是工具。这句话在人工智能时期一样也适用。

“让机器做机器善于的事情,让人类发挥人类的特长,让人工智能拓展人类智能。”—— 李佳芮《 Chatbot从0到1 》

未来可期,加油~

以上

- 中

tk账号购买:https://www.tiktokfensi.com/