十问AI研究:解构ChatGPT背后的气力和边界

来源:高毅资产管理(ID:gyzcgl)

1.为何大家都如此关注ChatGPT?

相较于其它物种,人类的智慧在于我们是工具创造者。回顾科学史,所有科学家一直在寻求:人类有无可能创造出和我们一样类似的高级智人?AGI(Artificial general intelligence通用人工智能)是计算机发展半个多世纪以来不断寻求的“圣杯”。

ChatGPT给大家打开了这个想象空间。

2.ChatGPT能做甚么?

读书写字、数字分析、信息提炼、总结知识、教授方法、智库分享、翻译等等,ChatGPT用对话的情势展现了大语言模型在内容整理和摘要方面的突破性进展。每一个人都可以通过自己的探索发现新的AI利用场景,之前我们需要100个APP的工作,一个AI机器人就可以完成。乃至我们每一个人都可以成为AI科学家。

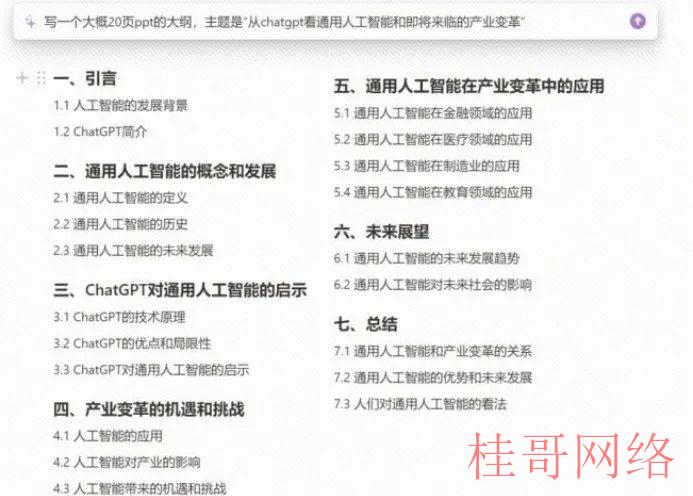

图片来源:chatGPT

3.ChatGPT从哪里来?背后的核心原理是甚么?

ChatGPT其实不是横空出世。70余年来,全部计算机技术的发展在一定程度上都可以看做对人工智能技术的一次次突破和前进,从初期符号主义、逻辑主义的简单规则设置,到今天大语言模型代表的统计规律成功,人类在一步步迈向通用人工智能。

20年来人工智能的最大突破就是从堆叠逻辑到统计学,而ChatGPT是过去十年来AI技术积累的集中成果展现。

ChatGPT背后的技术动力源泉就是LLM大语言模型(Large Language Model),LLM背后的核心原理就是统计计算。通过建立一个有上千亿个变量的复杂数学方程来摹拟我们大脑中的语言规则,一旦得到方程,每一个词都变成了几率,语言就能够被计算出来。相当于我们只要有这个方程就知道这句话该这样说,或这句话以后表意甚么。

举个例子,假设我们让AI做续写 “The best thing about AI is its ability to”,让它给我补充后面的句子该填写甚么,这时候机器会怎样做呢?它通过海量语料发现前面出现“The best thing about AI is its ability to”以后,出现最高几率的五个词是do、understand、make、predict、learn,它在其当选择几率较高的learn补全了这个句子。本质上所谓的大语言模型就是选出最可能的下一个词。

如果大家用过ChatGPT类的产品,会发现一个很成心思的交互特点,就是它的词是一个一个往外蹦的,不是由于他们做成特殊的交互,是由于机器真的在算,只有算出上一个词,再把这个句子重新带回去,才知道出现最高几率的词是甚么,所以它的展现只能是一个词一个词往外蹦,这不是摹拟打字的效果,而是它真实的在后台计算。

4.人类大脑的语言规则如此复杂,ChatGPT是怎样得出这套复杂的公式?又是怎样履行完成的?

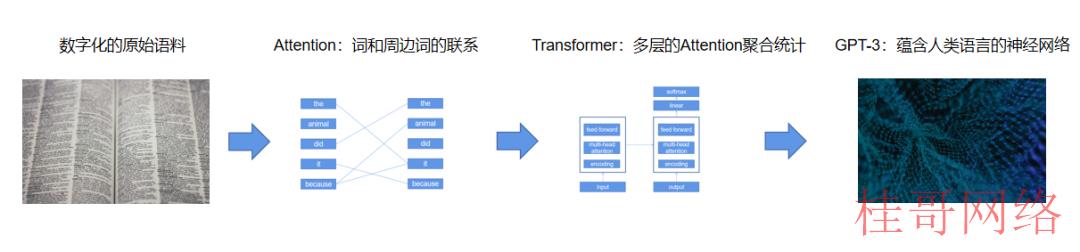

数据量足够大、计算量足够大,就会产生质变——机器能掌握更接近语言规则的高维度复杂的工程,也就是我们自己都不能言说的方程,诞生了今天这样的效果。这就是ChatGPT背后的大语言模型原理,看结构其实不复杂,但每步工程都需要很多血汗和汗水的突破。是一个延续近十年的工程:

2014年Attention机制的提出,它是一种算法;

2017年石破天惊的Transformer结构论文,相当于诞生出有庞大知识库、非常强大能力的大模型,但它的主要问题是不太会与人沟通;

2020年的GPT⑶,依托Transformer机制和海量数据训练,一步一步关键技术解决和迭代的进程,才诞生了今天的大语言模型。

5.为何是ChatGPT?为何不是其他产品?

非常关键的一点就是人工反馈的强化学习,也就是RLHF(Reinforcement Learning from Human Feedback)。本质上ChatGPT = GPT⑶.5 + RLHF,GPT是其支持模型,模型背后真实的科技是LLM海量数据统计的出现效应,而RLHF技术是其效果突围的关键。

LLM和RLHF的关系,LLM就像一个聪明、有知识但不善言辞的孩子,RLHF就是用一系列例子教会他人类平常交换的模式。GPT⑶依托Transformer机制和海量数据训练,实现了对人类知识的初步统计归总;RLHF就是让人来给机器的输出打分,嘉奖“好话”,惩罚“坏话”,不断驯化AI的说话习惯,即强化学习人类平常交换模式。两层模型堆叠,输出了非常好的ChatGPT产品。

6. ChatGPT能取代人吗?

盈亏同源,ChatGPT大语言模型的核心原理就是“统计+强化”,这决定了它不是真的理解,由于语言不是知识,模仿不是理解,说得像人话其实不等于真的明白话的含义。AI是一个抄作业的人,它通过人类浩大的语料去抄或模仿人曾做过的事,它其实不真正明白这件事,只是由于它抄过的东西太多,所以可以抄得非常强大、非常准,抄得非常像人话,但这其实不等于它真的理解。

当我们问AI 3+5等于多少,大家以为它用计算器算3+5是多少,其实不是,它是去浩大的语料里找哪儿出现过3+5,统计3+5后面基本都是出现8,因而把8贴上了,这意味着它极可能有很多错漏。

这也回答了很多人目前的耽忧:AI还不能取代人。由于AI没有人类的常识,它是抄作业,它一本正经,语法很通顺,写得很好,看起来非常专业,除不对,几近没缺点。但它还需要延续解决真实性和有效性的问题,这会限制它在很多要求准确率更高的场景下的延续扩大。

7.AI未来会取代人吗?

它现在还难以说是真实的AGI,让机器从“掌握信息”升级为“掌握知识”还需要AI科技的进一步突破,具有逻辑的自主学习和推演能力才是AGI,通往未来,会使用工具的AI将造就新的入口和新的平台,

本次AI最大的想象空间在于其方法论:AGI=DL+RL(深度学习+强化学习),指向了一个曾只出现在科幻电影中的全能服务机器人。到那一天,我们的生活会产生很大变化。

它现在还难以说是真实的AGI,但我们已看到它开始深度改变我们的学习和生活。

8.机会在哪里?

数字化的上半场是云,下半场是AI 。参考移动时期,新技术不但带来了新的独角兽,也让掌握基础设施的巨头享受了新增量,AI对利用和云都是机会。

它现在还难以说是真实的AGI,但我们已看到它开始深度改变我们的学习和生活。如将大语言模型与机器视觉模型结合能够实现阅图理解、按文生图等新形态利用。多模态AI能综合利用对文字、视觉和语言等的认知能力,更加深入地嵌入我们的生活和工作,拓展出更多的利用场景。未来通过大语言模型,可以下降各类现有模型的落地实行本钱,让机器自动完成本来人材能解决的需求适配和功能对接,买通AI to B的最后一千米。

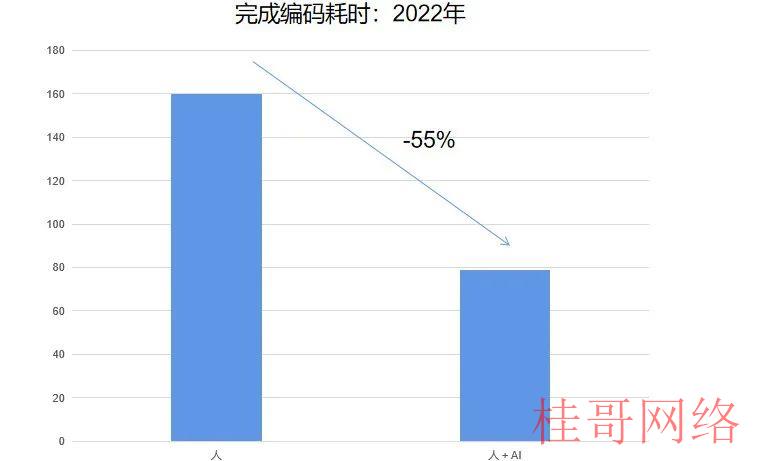

如能帮助人类生成代码,大幅下降程序代码编写的时间:

数据来源:ARK Investment : Artificial Intelligence

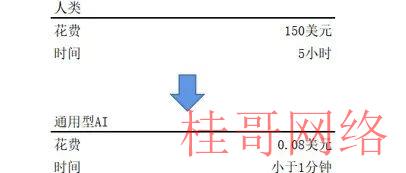

数据来源:ARK Investment : Artificial Intelligence

大幅下降图片和视频生产的本钱:

数据来源:ARK Investment : Artificial Intelligence

9.中国的机会在哪里?

我们还处在AIGC(AI Generated Content,人工智能生成内容),发展的初期阶段,行业的探索才刚刚开始。

中国具有完全的AI技术栈,也能有自己的ChatGPT。ChatGPT分为两层,一层是GPT模型,一层是嘉奖模型。国内在2021年前后基本完成了GPT⑶同级别的LLM模型,RLHF是需要时间打磨的人工策略积累,中国有更高的履行效力,客观看待中国ChatGPT初版的效果,会有差距,但可以追逐。

10.我们要做甚么?

乔布斯说过的一段话:What a computer is to me is the most remarkable tool that we have ever come up with. It’s the equivalent of a bicycle for our minds.

或许这一波AI的突破不单单是“自行车”,而是“汽车”,会把我们带向更光明的未来。隧道尽头的光已打在我们身上,接下来要做的可能就是一直向前。

版权声明:部份文章推送时未能与原作者获得联系。若触及版权问题,敬请原作者联系我们。

tk账号购买:https://www.tiktokfensi.com/